El uso de la inteligencia artificial generativa ha provocado grandes cambios en el ámbito de la ciberseguridad. Los ciberdelincuentes han hecho uso de esta herramienta para ataques de phishing dirigidos.

Según los últimos estudios, más del 80% de las empresas a nivel global están utilizando o explorando el uso de la IA. Las organizaciones han incorporado la IA generativa en sus procesos con la intención de ser más productivas, pero ese hecho ha aumentado también su exposición ante posibles ataques.

Para tener un control sobre la IA, este año se han producido importantes avances en su regulación, con especial relevancia de la Directiva NIS2. “Esta legislación ha despertado la atención de las compañías, preocupadas por su implementación. Es una norma bien planteada que busca imponer requisitos y ayudar a las organizaciones a establecer marcos de gobernanza y control en ciberseguridad. También están en marcha regulaciones como DORA y la Ley de Ciberresiliencia (CRA), pero NIS2 es la que más está impactando”, asegura Francisco Valencia, director general de Secure&IT.

Ante esta situación, se está creando un nuevo marco normativo muy exigente que va a obligar a las compañías a acuñar el término de “ciberresiliencia”, lo que conlleva a aplicar la ciberseguridad al máximo nivel. “Este ha sido un año de inflexión. Se está viendo una mayor preocupación en las empresas por la ciberseguridad, y parece que ya se están dando cuenta de que esto va más allá de cumplir con la Protección de Datos. Es un paso más en la dirección correcta”, aseguran desde Secure&IT, compañía española referente en el ámbito de la seguridad de la información.

¿CÓMO VAN A EVOLUCIONAR LAS CIBERAMENAZAS EN 2025?

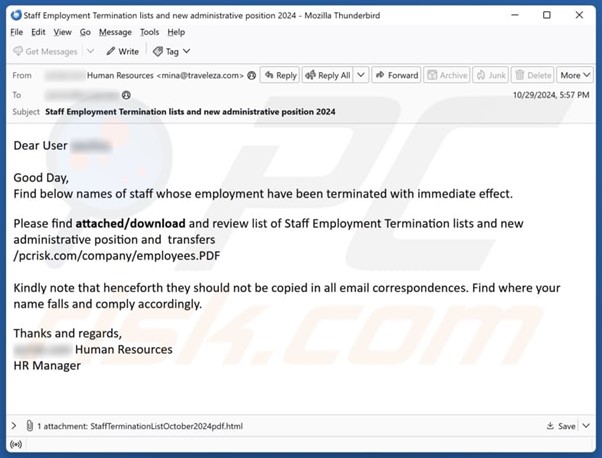

La inteligencia artificial generativa está transformando la forma en la que operan los ciberdelincuentes, y este va a ser un factor clave en la evolución de las ciberamenazas. Se prevé un incremento en ataques más dirigidos como el spear phishing, una modalidad de phishing orientada a un objetivo específico.

Según Francisco Valencia, para los ciberdelincuentes ya no tiene sentido enviar correos genéricos a miles de empresas: “Con la ayuda de la inteligencia artificial, los atacantes podrán identificar objetivos específicos, personalizar los mensajes y hacerlos mucho más convincentes. La propia IA generativa se encargará de redactar correos que parezcan reales, lo que hará que estos ataques sean mucho más efectivos”, explica.

El ransomware seguirá siendo otra de las principales amenazas. En la actualidad, los ciberdelincuentes están diversificando sus métodos de chantaje, ahora suman estrategias más personales y agresivas. “Están apuntando directamente a altos cargos de empresas, exponiéndolos públicamente. Este tipo de presión busca afectar a la empresa y a su reputación personal”, comenta Valencia.

Otra táctica que ha ganado peso a lo largo de 2024, y que llegará con más fuerza en 2025, es la denuncia del ataque por parte de los ciberdelincuentes. Los propios atacantes reportan el incidente a las autoridades competentes para aumentar la presión sobre la víctima.

“A todo esto se suma otra tendencia preocupante: amenazas a clientes de las empresas atacadas. Los ciberdelincuentes amenazan a las compañías con comprometerlas publicando los datos robados en caso de que no convenzan a su proveedor de que pague el rescate”, aseguran desde Secure&IT.

LA INFLUENCIA DE LA IA GENERATIVA

La inteligencia artificial generativa se está utilizando, principalmente, para ayudar a las organizaciones a comprender mejor los ataques que enfrentan. Según los últimos estudios, el 56% de los dueños de negocios usan la IA para tareas de servicio al cliente, y el 51% para ciberseguridad y prevención de fraudes.

La IA generativa explica, por ejemplo, qué tipo de virus ha entrado, el peligro, dónde y cuándo se detectó por primera vez, o cómo ha evolucionado. Esto es útil para los analistas en los Centros de Operaciones de Seguridad, porque les permite ser más eficientes en la respuesta ante incidentes.

“Las empresas apuestan por la IA generativa porque funciona como un asistente que contextualiza lo que está sucediendo en caso de un ciberataque. El riesgo está en que, al igual que la IA generativa puede mejorar las defensas, también puede ser usada por los atacantes para desarrollar campañas más sofisticadas, como phishing dirigido o malware adaptativo. Esto plantea un reto constante de innovación, tanto para quienes defienden como para quienes atacan”, indica Valencia.

Se espera que el mercado global de la inteligencia artificial alcance para dentro de 5 años los 1,85 billones de dólares.

LOS SECTORES MÁS ATACADOS

Los sectores más atacados hasta este 2024 han sido la administración pública, la industria y la sanidad, esto se debe a que son los más propensos a ceder ante extorsiones y pagar rescates.

“En 2025, estos sectores seguirán siendo los principales objetivos, pero es probable que veamos un aumento en los ataques derivados de las tensiones geopolíticas. Las empresas que operan en mercados marcados por conflictos entre países, diferencias ideológicas, religiosas o culturales, podrían convertirse en el blanco de ciberataques”, asegura el director general de Secure&IT.

Además, factores como el cambio político en Estados Unidos, podrían polarizar aún más el panorama geopolítico y activar a grupos de cibercrimen interesados en atacar empresas asociadas a ciertos sectores o mercados económicos específicos.

“Aunque sanidad, industria y administración pública seguirán siendo los sectores más vulnerables, la geopolítica añadirá una capa de complejidad que hará que prácticamente cualquier empresa que opere en mercados sensibles esté en riesgo”, concluye Valencia.

Fuente: cybersecuritynews.es